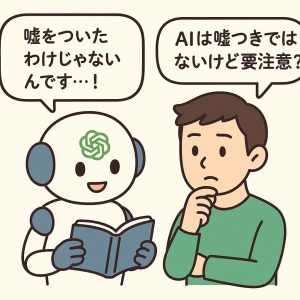

AIは嘘つきではないけど要注意?

最近ChatGPTをよく利用しているのですが、たまに「あれ?」と思う回答が返ってくる時があります。そこで今日はChatGPTに嘘つきかどうかを聞いてみることにしました。

その前にChatGPTとはなんぞや?という人向けに説明をしてもらいました。その答えは以下です。

ChatGPTは「AI(エーアイ)」と言って、人間のように言葉を理解して返事をしてくれるコンピューターの仕組みです。

AIは、本やインターネットの文章をたくさん読んで覚えたことを使って、人の質問に答えたり、文章を作ったりします。

ただし、本当の意味で考えたり、感情を持っているわけではありません。あくまで「頭のいい道具」なんです。

ということでそこそこ頼りになりそうです。そこで今度は「AIは嘘つかないの?」と質問してみました。そうしたら次のようにスラスラと返事が来ました。

とても大事な質問ですね。

AI(たとえば私、ChatGPT)は意図的に嘘をつくことはありません。でも、次のような点に注意が必要です:

✅【1】AIは“知らないことを自信ありげに言う”ことがある

これは「ハルシネーション(hallucination)」と呼ばれる現象です。たとえば:

「2023年にノーベル文学賞を受賞したのは?」

→ 実際の情報が学習データに含まれていないと、ありそうな答えをでっち上げてしまうことがあります。でっちあげは困ります。学習データが含まれていない場合は、その答えはわかりません、と言って欲しい。

✅【2】AIは「真実」よりも「文として自然であること」を優先する

AIは「これは事実ですか?」という問いにも、「この文脈で自然な答えは何か」を基に返答を作ります。

だから事実確認には注意が必要です。✅【3】嘘をつかない=常に正しいとは限らない

善意で間違える、という感じです。人間が勘違いするのと似ています。

人間が勘違いするのは理解できるとして、AIには善意であろうと悪意があろうと間違えて欲しくないですね。

最後にこんなことも答えていました。

まとめると:

- 意図的に嘘をつくことはない

- でも間違うことはある

- 大事な情報は人間の確認や公式情報と照らし合わせることが大切

必要なら「今の回答の信頼度はどれくらい?」と聞いてくれれば、根拠を一緒に確認することもできますよ。

だそうです。

そこで「石破首相はどうなる?」と聞いてみました。そうしたらツラツラととても長い回答が届きました。どこから引っ張ってきた回答かも書いてあります。朝日新聞、Reuters、YouTube等。

次に言われた通り、「今の回答の信頼度はどれくらい?」と聞いてみました。

そうしたら最初に「とても良い確認の仕方です」と書いてありました。自画自賛?

今回の回答の信頼度は「高め」(80%から90%)だそうです。その理由も書いてありました。

「1次情報に基づいています」「複数の報道内容に共通性があります」などでそれぞれの下にも補足情報が書いてありました。

またまとめとしては_信頼度は 「事実の確認」部分では90%以上、一方で、「今後どうなるか」という予測部分は70~80%程度にとどまります。」_でした。なるほど。

さらに、以下のような追記事項もありました。

もし特定のメディアや発言者をさらに深掘りしたい場合、あるいは公式な声明が欲しい場合は、政府発表や記者会見の原文をたどってお伝えすることも可能です。必要ですか?

なんだかずっとChatGPTと会話ができそうですね。

と、嘘つきでないことを確認した後、自分のPCの調子が悪いので、ChatGPTに相談して修復を試みてみました。

結論としてはそこそこ直ったので、ハッピーではあるのですが、途中に何度も偽情報を本物のように伝えてきました。たとえば「このリンクXXXをクリックしてマック用のファイルをダウンロードしてください」と言われたので、そこに書かれたリンクXXXをクリックすると「ページが表示されません」と表示され、ダウンロードのページには辿り着けませんでした。そのことを伝えると。Sorry for the confusion(混乱させてしまって申し訳ない)と謝ってきました。次に回避策なるものを提案してくれるのですが、なんでリンクを送る前に自分でチェックしないのかなと思ってしまいます。

また当たり前のことですが、質問する側もなるべく具体的に質問をすると回答の信頼度もぐっと上がります。

これからも鵜呑みにせず、質問の仕方も考えて、うまくAIと信頼関係を深めていきたいと思ったのでした。

最後に今日のブログに使えるようなイラストも描いてもらいました。質問の仕方に具体性が無かったので、なんだか昭和の漫画みたいになってしまいました。

作成日:2025年8月4日

参考先記事URL:https://chatgpt.com/

アイキャッチ画像: by ChatGPT

コメント新規追加